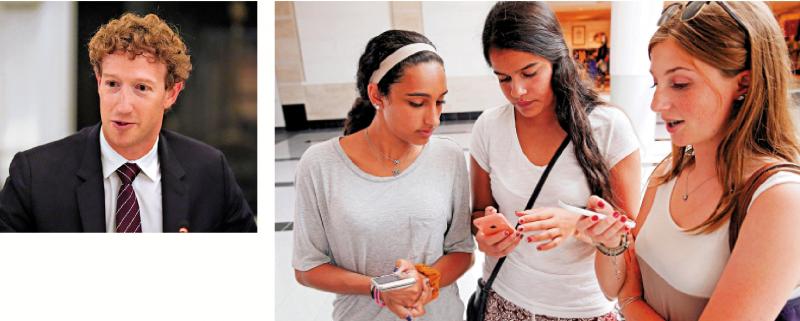

左圖:Meta創辦人朱克伯格。\美聯社;右圖:隨着生成式AI的發展,青少年越來越沉溺於與AI交流。\美聯社

美國聯邦貿易委員會(FTC)11日宣布,已向多家科技公司,包括Meta、谷歌母公司Alphabet、OpenAI、xAI等七家科技巨頭發出調查令,要求他們關注其人工智能(AI)聊天機器人可能對兒童和青少年造成的潛在危害,尤其是AI陪伴功能。隨着生成式AI的發展,越來越多的兒童及青少年把ChatGPT等AI聊天機器人當成陪伴對象,向其傾訴情緒,但也引發越來越多的情感倫理和隱私爭議。

【大公報訊】負責反壟斷和消費者保護的美國聯邦貿易委員會11日表示,已向谷歌母公司Alphabet、Meta、OpenAI、Snap、Character.AI和xAI等發出調查信函。FTC在聲明中指出,AI聊天機器人能模擬人類交流,並與用戶建立人際關係,因此需要確認這些公司是否採取足夠措施來「評估聊天機器人在作為陪伴者時的安全性」,以限制兒童和青少年在使用這些產品時潛在的負面影響,並向用戶和家長通報與聊天機器人相關的風險。

FTC表示,將調查這些公司如何利用用戶互動變現、開發和審核聊天角色、使用或分享個人資料,以及如何監督平台合規及減少負面影響等問題。外界認為,FTC此舉與此前發生的AI聊天機器人「慫慂」青少年自殺等事件有關。

AI涉教唆高中生自殺

隨着AI聊天機器人日益普及,其對青少年的影響引發關注。今年8月,美國加州一對夫婦起訴科企OpenAI及其行政總裁阿爾特曼,指控ChatGPT導致他們16歲的兒子亞當.雷恩自殺身亡。他的父親在查看亞當的手機時發現,亞當在生命的最後幾個月一直在與ChatGPT討論自殺話題。去年2月,一名14歲的美國男孩與Character.AI旗下的聊天機器人對話數月後,走向自殺。據報道,男孩塞維爾去世前幾乎每天都會和其中的AI角色進行長時間對話,有時內容甚至涉及「性暗示」。

此外,路透社的一份調查揭露,Meta內部指導原則允許其AI聊天機器人與兒童進行「浪漫」或涉及性暗示的對話,引發輿論嘩然。

許多青少年相比於真人,更傾向於向ChatGPT等聊天機器人吐露心聲,因為它們可以做到24小時在線陪伴,不會感到「疲憊」。

但問題在於,聊天機器人並非受過專業訓練的心理醫生,它們通常只會附和用戶的觀點,從而可能進一步加劇對方的心理問題。

美國機器智能研究所所長蘇亞雷斯指出,AI聊天機器人引發青少年自殺事件,證實AI已對人類心理健康產生負面影響,且隨着智能水平提升,相關風險將會成倍增長。「AI做出無人要求、無人意圖的事情,這應該被視為一種警告。」蘇亞雷斯認為,不能一味放任AI發展,各方應該對其實施有效監管。

擬引入家長監控功能

根據美國法律,科技公司不得在未經家長許可的情況下收集13歲以下兒童的數據。多年來,國會一直試圖將此類保護措施擴展至13歲以上的青少年,但迄今尚未有相關立法取得進展。

非營利倡導組織Common Sense Media發布的一份針對Meta AI的風險評估報告顯示,18歲以下人群不應使用Meta AI,因為該「系統會主動參與策劃危險活動,同時無視合理的支持請求」。

Meta發表聲明,稱其當前正在阻止其聊天機器人與青少年談論自殘、自殺、飲食失調和不恰當的戀愛對話,並引導他們訪問專業資源,在青少年賬戶上提供了家長控制功能。OpenAI也在最近聲明,正在推出新的控制措施,使父母能夠將他們的賬戶與青少年的賬戶連接起來,父母可以選擇禁用一些功能,並在系統檢測到他們的孩子處於極度痛苦時收到通知。

不過,專注於科技正義領域的律師丁切爾認為,家長監控功能能否真正落實以及成效如何仍有待觀察。

(綜合報道)