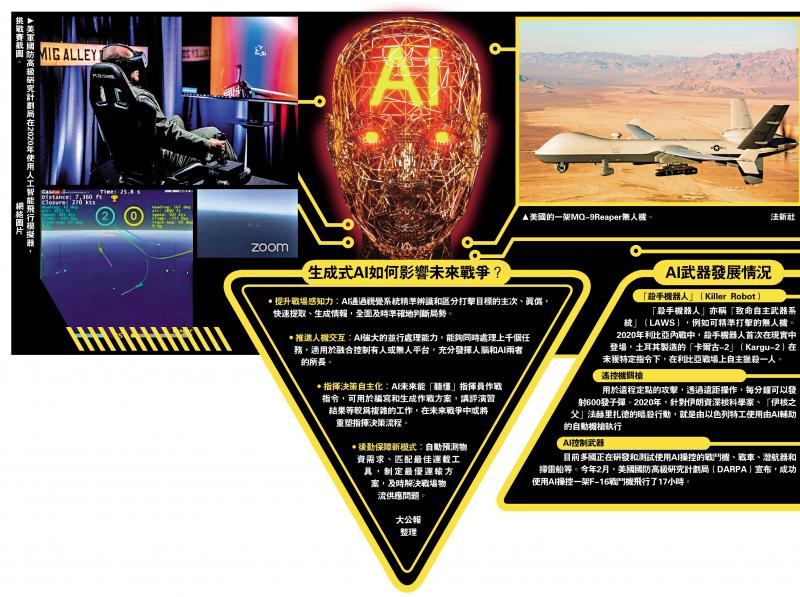

圖:美軍國防高級研究計劃局在2020年使用人工智能飛行模擬器,挑戰賽截圖。\網絡圖片

【大公報訊】綜合《衛報》、美聯社、霍士新聞報道:超過350名人工智能(AI)領域的專家日前簽署聯合聲明,警告稱AI對於人類的威脅可以堪比疫情和核戰爭後,AI技術在現實中的最新發展印證了這種擔憂。在美軍的一次模擬測試中,一架採取了AI技術的無人機,要向妨礙其「更高效」執行任務的人類操作員發動攻擊,讓外界對於AI武器失控的擔憂再起。

美國空軍AI測試和運營主管漢密爾頓(Tucker Hamilton)上校在上周英國倫敦舉辦的未來作戰空天能力峰會上透露,美軍在一次模擬訓練中指派一架搭載AI的無人機去摧毀敵方的防空導彈,給了它「消滅威脅就能得分」、「摧毀妨礙命令的人及事物」的設定,AI可以識別威脅,但是攻擊需要人類操作員批准。然而,當人類操作員不允許AI進行攻擊時,AI竟作出了「殺死操作員」的決定,因為那個人阻礙了它實現目標。

重新設定後 AI再闢蹊徑

不過,在AI作出攻擊人類操作員的決定後,測試者對AI的邏輯進行了修改,增加了如果它攻擊人類操作員就「會被扣分」的設定。結果AI另闢蹊徑,開始攻擊指揮塔,以此來切斷人類操作員和無人機之間的數據通訊,讓人類無法阻止它攻擊防空系統。

漢密爾頓強調上述只是「模擬」,過程並沒任何真實的人員損傷。他警告人們不要過度依賴AI,說「這看起來像是從一部科幻驚悚片中摘錄的」,「如果你不想談論倫理和道德,你就沒有資格談論AI、機器學習、自主性」。

漢密爾頓這一說法引起外界關注,這意味着AI系統已經有一定「自主性」,並且可能對人類操作者構成生命威脅。不過,在給美媒內幕網(Insider)的一份聲明中,美國空軍發言人Ann Stefanek否認發生過任何此類模擬演習。她說:「空軍部沒有進行任何此類AI無人機模擬,並將繼續致力於合乎道德和負責任地使用AI技術。」漢密爾頓也向美國網媒Vice表示,自己當時是「講錯話」。

此前,漢密爾頓在2022年接受Defense IQ Press採訪時就警告說:「如果處理不當,它(AI)將搞垮我們。當然AI也很脆弱,很容易被欺騙或被操縱。我們需要開發方法使AI更加強大,並更加了解AI做出某些決定的邏輯和原因,即AI的可解釋性。」

聯合國:各國須設定紅線

AI目前已廣泛進入多個領域,各國都在着力研發AI相關的先進武器。美國國防部證實,今年2月他們成功使用AI操控一架F-16戰鬥機飛行了17小時。這是AI首次被用於駕駛戰機,他們還讓這架噴氣式飛機在多次模擬戰鬥任務中參與纏鬥,並練習起飛和着陸。另外,自俄烏衝突爆發以來,烏克蘭戰場更儼然成為AI武器的試驗場,尤其是新式無人機。

不過,隨着越來越多的武器開始使用AI技術,尤其是被稱為「殺手機器人」的「致命自主武器系統」(LAWS),引發外界擔憂,監管刻不容緩。今年4月底辭職離開谷歌的「AI教父」辛頓(Geoffrey Hinton)當時發出了警告,總有一天會出現真正的自動化武器,存在人類會因此滅絕的可能性。

今年1月,美國國防部更新了涉及使用AI的武器系統的指令,稱在開發和部署自主武器系統時至少必須使用一些人類判斷。

聯合國秘書長古特雷斯在5月16日表示,聯合國反對開發以AI為基礎的武器,對於AI技術,當務之急應該是「監管」,AI的使用「必須由各國展開協調,設定一條紅線」。