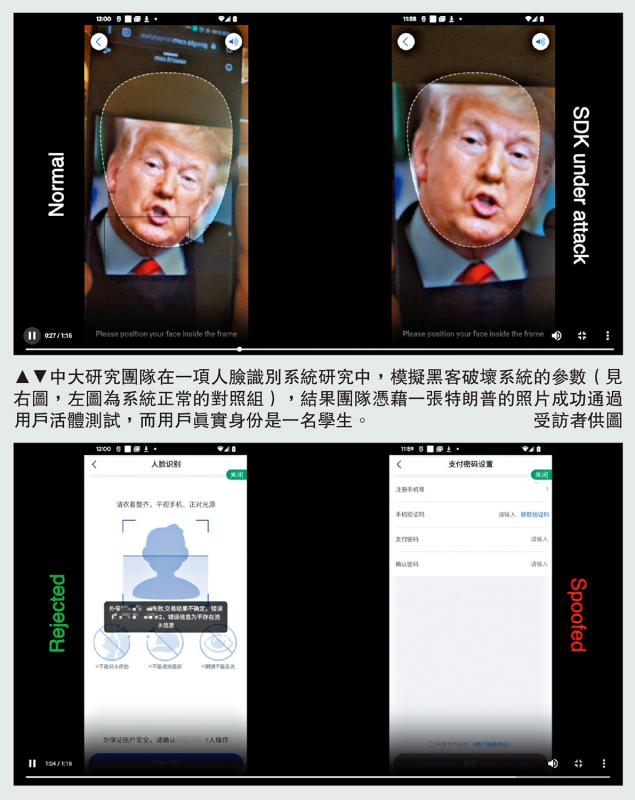

圖:中大研究團隊在一項人臉識別系統研究中,模擬黑客破壞系統的參數(見右圖,左圖為系統正常的對照組),結果團隊憑藉一張特朗普的照片成功通過用戶活體測試,而用戶真實身份是一名學生。\受訪者供圖

人臉識別技術的發展和普及應用勢不可當,惟現階段技術仍有待完善,除了其安全性需要提升以外,該技術存在不便利、不公正等現象。這些弊端不但影響用家的體驗,亦令到這項技術在許多國家和地區都存在不同程度的法律爭議。

中大工程學院信息工程學系的劉永昌教授以身邊個案為例,指用戶在手機銀行APP驗證人臉識別時,系統會要求用戶做出眨眼、搖頭等動作,但經常因為網絡問題而驗證失敗,需要重複幾次相同的動作才能通過驗證。「啲接觸信號窒下窒下,搞咗成半個鐘都搞唔定。」因此,按照現在的技術,似乎網絡安全和便利有些衝突,「你想最簡單、方便,就最不安全;你想最安全,但有可能最不方便。」

有黑人被識別成「大猩猩」

除了不便利以外,人臉識別系統自帶的偏見性在愈來愈多的報道和研究中體現。據2019年美國NIST發布的一項研究報告顯示,在一些人臉識別算法中,亞裔和非裔美國人被誤認的可能性比白人高100倍。其中最荒謬的案例,則是一位黑人發現自己被谷歌的算法識別成「大猩猩」。此外,在篩選簡歷方面,這類有算法偏差的人臉識別系統被證明因為誤判而將更多的有色人種淘汰。

個人資料私隱專員鍾麗玲對大公報記者表示,誤判有色人種的人臉識別系統則與訓練該系統的數據庫有關,以美國該案例為例,其數據庫中獲得的白人數據更多,有色人種數據更少,而系統的學習自然是越多數據越能學習得準確。「因此人臉識別數據庫的準確性以及完整性都好緊要。」\大公報記者 苑向芹